Ethik in der Robotik: Verantwortungsvolle Innovation

Die rasante Entwicklung der Robotertechnologie eröffnet faszinierende Möglichkeiten, wirft aber gleichzeitig grundlegende ethische Fragen auf. Während Roboter immer autonomer, intelligenter und präsenter in unserem Alltag werden, müssen wir uns mit den moralischen Implikationen dieser Technologien auseinandersetzen. In diesem Artikel beleuchten wir die ethischen Herausforderungen in der Robotik und diskutieren Ansätze für eine verantwortungsvolle Innovation, die technologischen Fortschritt mit menschlichen Werten in Einklang bringt.

Die ethischen Dimensionen der Robotik

Die Ethik der Robotik umfasst ein breites Spektrum moralischer Fragestellungen, die sich aus der Entwicklung, dem Einsatz und den Auswirkungen von Robotertechnologien ergeben. Diese Fragen lassen sich in verschiedene Dimensionen einteilen:

1. Autonomie und Entscheidungsfindung

Mit zunehmender Autonomie von Robotersystemen stellen sich grundlegende Fragen zur Entscheidungsfindung:

- Moralische Algorithmen: Wie programmieren wir Roboter, damit sie moralisch akzeptable Entscheidungen treffen?

- Dilemma-Situationen: Wie sollen autonome Systeme in moralischen Dilemma-Situationen handeln, beispielsweise bei unvermeidbaren Unfällen autonomer Fahrzeuge?

- Wertesysteme: Welche ethischen Werte sollen in autonome Systeme einprogrammiert werden, und wer entscheidet darüber?

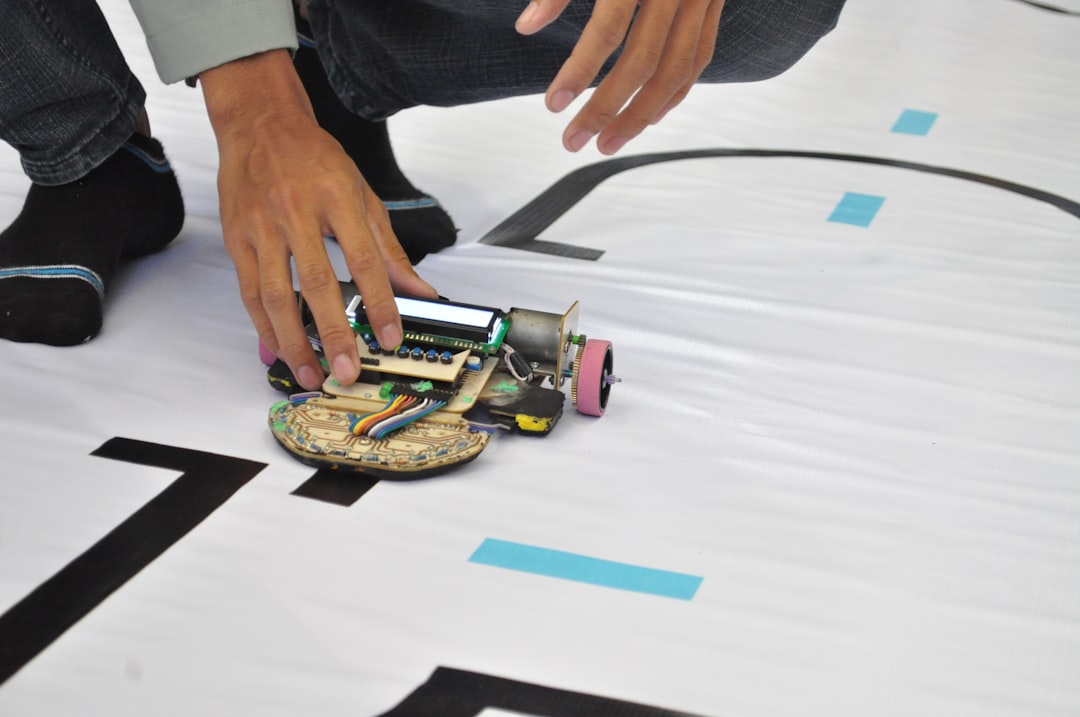

Die Programmierung moralischer Entscheidungsfindung ist eine der größten Herausforderungen der Roboterethik

Das bekannte "Trolley-Problem" - bei dem ein Fahrzeug zwischen verschiedenen schädlichen Szenarien entscheiden muss - illustriert die Komplexität solcher ethischen Dilemmata. Bei autonomen Robotern geht es jedoch weit über Verkehrssituationen hinaus und betrifft alle Bereiche, in denen Roboter selbstständig Entscheidungen treffen müssen.

2. Verantwortung und Haftung

Die zunehmende Autonomie von Robotern wirft Fragen zur Verantwortungszuschreibung auf:

- Verursacherhaftung: Wer trägt die Verantwortung, wenn ein autonomer Roboter einen Schaden verursacht?

- Verantwortungslücke: Kann eine "Verantwortungslücke" entstehen, wenn weder Hersteller noch Nutzer für bestimmte Handlungen eines Roboters verantwortlich gemacht werden können?

- Rechtliche Rahmenbedingungen: Wie müssen Haftungsregelungen angepasst werden, um den Besonderheiten autonomer Systeme gerecht zu werden?

Diese Fragen haben sowohl philosophische als auch praktische rechtliche Implikationen. Die EU-Kommission arbeitet beispielsweise an einer Anpassung der Produkthaftungsrichtlinie, um den Herausforderungen durch KI und Robotik gerecht zu werden.

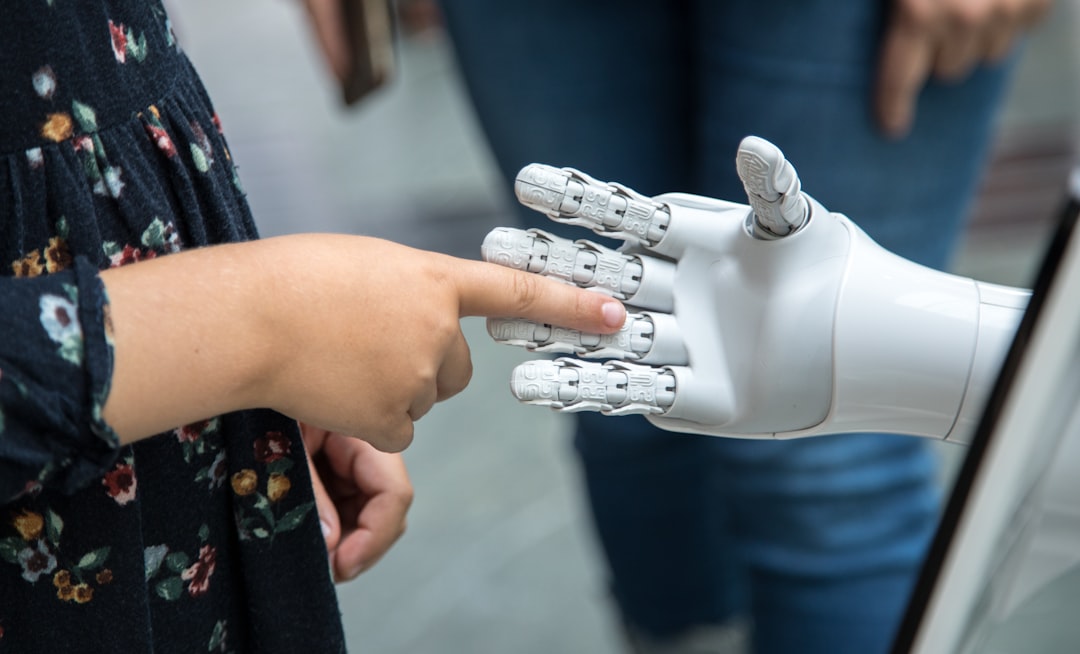

3. Menschliche Würde und Autonomie

Der Einsatz von Robotern in sensiblen Bereichen wirft Fragen zur Wahrung der menschlichen Würde auf:

- Pflege und Betreuung: Inwieweit ist der Einsatz von Robotern in der Pflege mit der Würde der Pflegebedürftigen vereinbar?

- Entscheidungsautonomie: Wie kann sichergestellt werden, dass Roboter die Entscheidungsautonomie von Menschen respektieren und fördern?

- Instrumentalisierung: Besteht die Gefahr, dass menschliche Beziehungen durch den Einsatz von Robotern instrumentalisiert werden?

"Die zentrale ethische Herausforderung der Robotik besteht darin, Technologie zu entwickeln, die menschliche Fähigkeiten erweitert, ohne menschliche Werte zu untergraben." - Prof. Dr. Elisabeth Weber, Ethikerin

4. Privatsphäre und Datenschutz

Moderne Roboter sammeln und verarbeiten große Mengen personenbezogener Daten:

- Datensicherheit: Wie können sensible Daten vor unbefugtem Zugriff geschützt werden?

- Überwachungspotenzial: Wie kann verhindert werden, dass Roboter zu Überwachungszwecken missbraucht werden?

- Informierte Einwilligung: Wie kann eine wirklich informierte Einwilligung zur Datenverarbeitung durch komplexe Robotersysteme gewährleistet werden?

Serviceroboter sammeln umfangreiche Daten über ihre Umgebung und die Menschen darin

5. Soziale Auswirkungen und Arbeitswelt

Die zunehmende Verbreitung von Robotern hat tiefgreifende Auswirkungen auf die Gesellschaft:

- Arbeitsmarkt: Wie gehen wir mit dem Verlust von Arbeitsplätzen durch Automatisierung um?

- Soziale Ungleichheit: Besteht die Gefahr einer Verschärfung sozialer Ungleichheiten durch ungleichen Zugang zu Robotertechnologien?

- Bildung und Kompetenzen: Welche neuen Fähigkeiten müssen Menschen entwickeln, um in einer Welt mit fortschrittlicher Robotik zu bestehen?

Ethische Rahmenbedingungen und Leitlinien

Angesichts dieser vielfältigen ethischen Herausforderungen wurden in den letzten Jahren verschiedene Ansätze entwickelt, um ethische Rahmenbedingungen für die Robotik zu schaffen:

Internationale Leitlinien und Prinzipien

Verschiedene Organisationen haben ethische Leitlinien für Robotik und KI formuliert:

- IEEE Global Initiative on Ethics of Autonomous and Intelligent Systems: Entwickelt Standards für ethisches Design

- EU-Ethikleitlinien für vertrauenswürdige KI: Definieren Grundprinzipien wie Transparenz, Nichtdiskriminierung und Verantwortlichkeit

- OECD-Prinzipien zu KI: Setzen einen internationalen Standard für den verantwortungsvollen Umgang mit KI

Diese Leitlinien betonen gemeinsame Grundwerte wie menschliche Autonomie, Vermeidung von Schaden, Fairness und Erklärbarkeit. Sie dienen als Orientierungsrahmen für Entwickler, Unternehmen und politische Entscheidungsträger.

Ethik by Design

Ein vielversprechender Ansatz ist die Integration ethischer Überlegungen direkt in den Entwicklungsprozess ("Ethics by Design"):

- Value Sensitive Design: Methodologie zur Berücksichtigung menschlicher Werte im gesamten Designprozess

- Ethische Folgenabschätzung: Systematische Analyse potenzieller ethischer Auswirkungen während der Entwicklung

- Partizipative Entwicklung: Einbeziehung verschiedener Stakeholder, einschließlich potenzieller Nutzer, in den Entwicklungsprozess

Dieser Ansatz zielt darauf ab, ethische Überlegungen nicht nachträglich auf fertige Technologien anzuwenden, sondern sie von Anfang an in den Entwicklungsprozess zu integrieren.

Regulatorische Ansätze

Neben freiwilligen Leitlinien werden zunehmend auch regulatorische Maßnahmen diskutiert und implementiert:

- EU AI Act: Vorschlag für eine umfassende Regulierung von KI-Systemen basierend auf Risikoklassen

- Sektorspezifische Regelungen: Spezifische Vorschriften für besonders sensible Bereiche wie Gesundheitswesen oder autonomes Fahren

- Zertifizierungssysteme: Entwicklung von Zertifizierungen für ethisch verantwortungsvolle Robotik

Die Entwicklung angemessener regulatorischer Rahmenbedingungen ist ein komplexer Balanceakt

Die Herausforderung besteht darin, einen regulatorischen Rahmen zu schaffen, der Innovation nicht unnötig behindert, aber gleichzeitig grundlegende ethische Werte schützt.

Ethische Herausforderungen in verschiedenen Anwendungsbereichen

Die ethischen Implikationen der Robotik variieren je nach Anwendungsbereich und erfordern differenzierte Betrachtungen:

Medizinische Robotik

Im Gesundheitswesen ergeben sich spezifische ethische Fragestellungen:

- Vertrauen und Patientenautonomie: Wie beeinflussen Roboter das Vertrauensverhältnis zwischen Ärzten und Patienten?

- Zugangsgerechtigkeit: Wie kann ein gleichberechtigter Zugang zu fortschrittlicher Robotermedizin gewährleistet werden?

- Risikobewertung: Wie werden Risiken neuer robotischer Verfahren gegen potenzielle Vorteile abgewogen?

- Datennutzung: Wie werden sensible Gesundheitsdaten geschützt und ethisch vertretbar genutzt?

Der Einsatz von Robotern in der Chirurgie beispielsweise verspricht höhere Präzision, wirft aber Fragen nach Verantwortung bei Komplikationen und nach der notwendigen menschlichen Aufsicht auf.

Pflege- und Betreuungsroboter

Bei Robotern in der Pflege stehen besonders sensible ethische Fragen im Vordergrund:

- Menschliche Zuwendung: Können und sollten Roboter menschliche Zuwendung ersetzen?

- Täuschung: Ist es ethisch vertretbar, wenn soziale Roboter emotionale Bindungen suggerieren?

- Selbstbestimmung: Wie kann die Autonomie pflegebedürftiger Menschen respektiert werden?

- Würde: Wie beeinflusst der Einsatz von Robotern die Würde vulnerabler Personengruppen?

"Die Herausforderung bei Pflegerobotern besteht nicht darin, menschliche Pflegekräfte zu ersetzen, sondern sie zu entlasten, damit sie mehr Zeit für die zwischenmenschlichen Aspekte der Pflege haben." - Dr. Andreas Fischer

Militärische Robotik

Besonders kontrovers wird der Einsatz autonomer Waffensysteme diskutiert:

- Tödliche autonome Waffensysteme: Sollten Roboter eigenständig über den Einsatz tödlicher Gewalt entscheiden dürfen?

- Verantwortungskette: Wie kann eine klare Verantwortungszuschreibung gewährleistet werden?

- Völkerrecht: Wie lassen sich autonome Waffensysteme mit den Prinzipien des humanitären Völkerrechts vereinbaren?

Zahlreiche Organisationen und Experten fordern ein präventives Verbot vollautonomer Waffensysteme, während die technologische Entwicklung voranschreitet.

Serviceroboter und persönliche Assistenten

Im privaten Umfeld ergeben sich weitere ethische Fragestellungen:

- Überwachung: Wie kann verhindert werden, dass Haushaltsroboter zu Überwachungszwecken missbraucht werden?

- Datenschutz: Wie wird mit den umfangreichen Daten umgegangen, die in privaten Räumen gesammelt werden?

- Abhängigkeit: Besteht die Gefahr einer übermäßigen Abhängigkeit von robotischen Assistenten?

- Manipulation: Wie kann verhindert werden, dass Serviceroboter zu Manipulationszwecken eingesetzt werden?

Serviceroboter gewinnen Einblicke in unsere privatesten Lebensbereiche

Praktische Ansätze für ethisch verantwortungsvolle Robotik

Wie lassen sich die diskutierten ethischen Prinzipien in die Praxis umsetzen? Hier einige konkrete Ansätze:

Transparenz und Erklärbarkeit

Eine Grundvoraussetzung für ethische Robotik ist Transparenz:

- Explainable AI (XAI): Entwicklung von Methoden, die die Entscheidungen von KI-Systemen nachvollziehbar machen

- Informationspflichten: Klare Kommunikation der Fähigkeiten, Grenzen und Datennutzung von Robotersystemen

- Kennzeichnung: Eindeutige Erkennbarkeit von Robotern in der Interaktion mit Menschen

Transparenz ermöglicht informierte Entscheidungen über den Einsatz von Robotertechnologie und schafft Vertrauen bei den Nutzern.

Partizipative Entwicklung und Technikfolgenabschätzung

Die Einbeziehung verschiedener Perspektiven ist entscheidend:

- Diversität in Entwicklungsteams: Förderung vielfältiger Teams mit unterschiedlichen Hintergründen und Perspektiven

- Nutzereinbindung: Frühzeitige und kontinuierliche Einbeziehung potenzieller Nutzer in den Entwicklungsprozess

- Interdisziplinäre Zusammenarbeit: Kooperation zwischen Ingenieuren, Ethikern, Sozialwissenschaftlern und anderen relevanten Disziplinen

- Technikfolgenabschätzung: Systematische Analyse potenzieller gesellschaftlicher Auswirkungen neuer Robotertechnologien

Dieser partizipative Ansatz hilft, blinde Flecken zu vermeiden und sicherzustellen, dass Robotertechnologien den Bedürfnissen und Werten verschiedener gesellschaftlicher Gruppen gerecht werden.

Ethik-Boards und Governance-Strukturen

Institutionelle Mechanismen können ethische Reflexion fördern:

- Unternehmensethik-Boards: Etablierung unabhängiger Gremien zur ethischen Bewertung von Robotikprojekten

- Ethische Leitlinien: Entwicklung spezifischer ethischer Kodizes für verschiedene Anwendungsbereiche

- Whistleblower-Schutz: Schaffung sicherer Kanäle für die Meldung ethischer Bedenken

- Externe Überprüfung: Unabhängige Audits und Zertifizierungen für ethische Robotik

"Ethische Reflexion darf kein Anhängsel sein, sondern muss integraler Bestandteil der Robotikforschung und -entwicklung werden." - Prof. Dr. Markus Schulz, Technikethiker

Aus- und Weiterbildung

Die Förderung ethischer Kompetenz ist entscheidend:

- Integration ethischer Inhalte in technische Studiengänge: Ausbildung ethisch sensibler Ingenieure und Entwickler

- Interdisziplinäre Bildungsangebote: Förderung des Austauschs zwischen technischen und ethischen Disziplinen

- Weiterbildung für Praktiker: Ethiktrainings für Personen, die mit Robotertechnologie arbeiten

- Öffentliche Bildung: Förderung des gesellschaftlichen Diskurses über Roboterethik

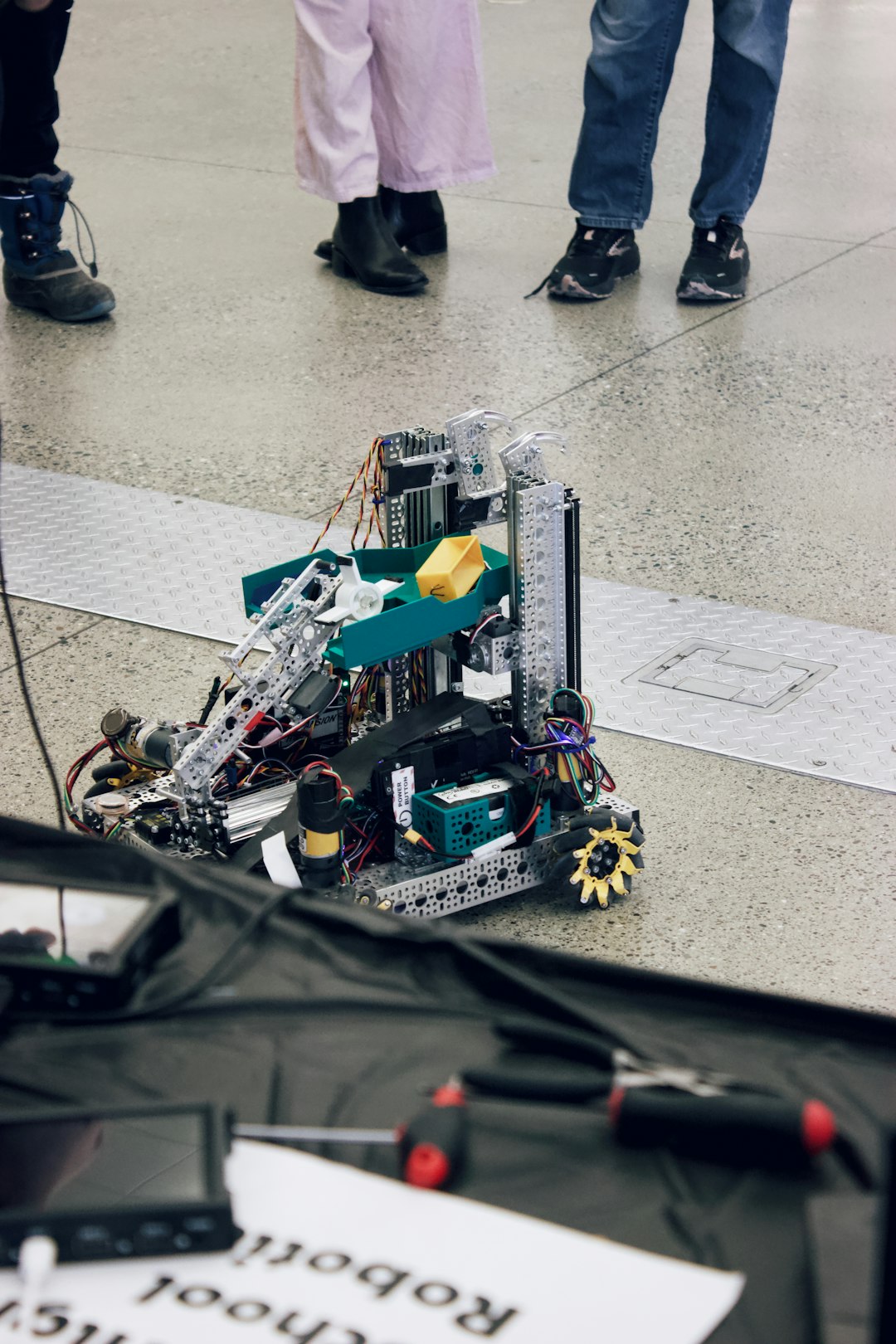

Interdisziplinäre Ausbildung ist entscheidend für eine ethisch reflektierte Entwicklung von Robotertechnologien

Fallstudien: Ethische Dilemmata in der Praxis

Konkrete Fallbeispiele verdeutlichen die komplexen ethischen Abwägungen in der Robotik:

Fallstudie 1: Autonomes Fahren und Unfallszenarien

Autonome Fahrzeuge stehen vor komplexen ethischen Entscheidungen bei unvermeidbaren Unfällen:

- Soll das Fahrzeug bei einem unvermeidbaren Unfall den Schutz der Insassen priorisieren oder die Minimierung des Gesamtschadens?

- Wie sollten demografische Faktoren wie Alter oder Anzahl der betroffenen Personen berücksichtigt werden?

- Wer trägt die Verantwortung für die Programmierung solcher Entscheidungsalgorithmen?

Die Ethik-Kommission zum automatisierten Fahren des deutschen Verkehrsministeriums hat hierzu Leitlinien formuliert, die unter anderem festlegen, dass eine Qualifizierung von Menschen nach persönlichen Merkmalen unzulässig ist.

Fallstudie 2: Soziale Roboter und emotionale Bindung

Soziale Roboter werfen Fragen zur Authentizität emotionaler Interaktionen auf:

- Ist es ethisch vertretbar, wenn Roboter emotionale Bindungen zu vulnerablen Gruppen wie Kindern oder Demenzkranken aufbauen?

- Inwieweit sollte die Simulation von Emotionen transparent gemacht werden?

- Welche langfristigen Auswirkungen hat die Interaktion mit sozialen Robotern auf die menschliche Sozialentwicklung?

Projekte wie der Therapieroboter PARO zeigen sowohl positive therapeutische Effekte als auch die Notwendigkeit, potenzielle langfristige Auswirkungen sorgfältig zu untersuchen.

Fallstudie 3: Arbeitsplatzautomatisierung und soziale Gerechtigkeit

Die Automatisierung durch Roboter hat tiefgreifende sozioökonomische Implikationen:

- Wie können die Vorteile der Automatisierung gerecht verteilt werden?

- Welche Verantwortung tragen Unternehmen gegenüber Mitarbeitern, deren Arbeitsplätze automatisiert werden?

- Welche politischen Maßnahmen sind notwendig, um negative soziale Auswirkungen abzufedern?

Verschiedene Modelle wie Umschulungsprogramme, kürzere Arbeitszeiten oder ein bedingungsloses Grundeinkommen werden als mögliche Antworten diskutiert.

Zukunftsperspektiven: Ethik für fortschrittliche Robotersysteme

Mit der weiteren Entwicklung der Robotik werden neue ethische Fragen aufkommen:

Künstliches Bewusstsein und Maschinenrechte

Langfristig könnten sich fundamentale ethische Fragen stellen:

- Wie würden wir mit Robotersystemen umgehen, die ein Bewusstsein oder bewusstseinsähnliche Zustände entwickeln?

- Unter welchen Umständen könnten Roboter moralischen Status oder sogar Rechte erlangen?

- Wie können wir feststellen, ob ein Roboter tatsächlich subjektive Erfahrungen hat?

Obwohl diese Fragen derzeit noch theoretisch erscheinen, ist es wichtig, sie frühzeitig zu diskutieren, um auf zukünftige Entwicklungen vorbereitet zu sein.

Globale Ethik in einer vernetzten Welt

Die globale Dimension der Roboterethik gewinnt an Bedeutung:

- Wie können ethische Standards international harmonisiert werden?

- Wie können kulturelle Unterschiede in ethischen Wertvorstellungen berücksichtigt werden?

- Wie kann verhindert werden, dass unterschiedliche ethische Standards zu einem "Race to the Bottom" führen?

Die Entwicklung globaler ethischer Standards für Robotik erfordert interkulturelle Sensibilität

Ethik für lernende Systeme

Besondere Herausforderungen ergeben sich bei selbstlernenden Robotersystemen:

- Wie können ethische Werte in Systeme integriert werden, die sich kontinuierlich weiterentwickeln?

- Wie kann verhindert werden, dass Roboter unerwünschte Verhaltensweisen erlernen?

- Welche Kontrollmechanismen sind notwendig, um die ethische Entwicklung lernender Systeme zu überwachen?

Ansätze wie "Value Alignment" und "Ethical Reinforcement Learning" zielen darauf ab, ethische Werte in den Lernprozess zu integrieren.

Fazit: Ethik als Motor für verantwortungsvolle Innovation

Die ethische Reflexion der Robotik sollte nicht als Hindernis für Innovation verstanden werden, sondern als Wegweiser für eine Technologieentwicklung, die menschliche Werte respektiert und fördert. Eine verantwortungsvolle Robotikentwicklung erfordert:

- Die kontinuierliche Integration ethischer Überlegungen in alle Phasen des Entwicklungsprozesses

- Einen interdisziplinären Dialog zwischen Technikern, Ethikern, Sozialwissenschaftlern und anderen relevanten Disziplinen

- Die Einbeziehung verschiedener gesellschaftlicher Perspektiven in die Gestaltung von Robotertechnologien

- Ein angemessenes Gleichgewicht zwischen Innovation und Vorsicht, zwischen technologischem Fortschritt und ethischen Werten

Letztendlich geht es darum, Robotertechnologien zu entwickeln, die nicht nur technisch fortschrittlich sind, sondern auch zum Wohl der Gesellschaft beitragen und grundlegende menschliche Werte wie Würde, Autonomie und Gerechtigkeit fördern.

Die Zukunft der Robotik wird maßgeblich davon abhängen, inwieweit es gelingt, technologische Innovation mit ethischer Reflexion zu verbinden. Eine verantwortungsvolle Entwicklung und Nutzung von Robotertechnologien bietet die Chance, wichtige gesellschaftliche Herausforderungen zu bewältigen und gleichzeitig menschliche Werte zu stärken.

Die Ethik der Robotik ist kein abgeschlossenes Feld, sondern ein kontinuierlicher Prozess, der mit der technologischen Entwicklung Schritt halten muss. Der gesellschaftliche Dialog über die ethischen Implikationen der Robotik bleibt daher eine dauernde Aufgabe für Wissenschaft, Wirtschaft, Politik und Zivilgesellschaft.

Kommentare (2)

Dr. Maria Schulz

23. Dezember 2023 um 09:30Ein sehr differenzierter Artikel, der die Komplexität des Themas gut erfasst! Als Ethikerin in einem Robotik-Forschungsprojekt erlebe ich täglich die Herausforderung, ethische Überlegungen in technische Entwicklungsprozesse zu integrieren. Die größte Hürde ist oft nicht der Mangel an ethischem Bewusstsein, sondern die fehlende gemeinsame Sprache zwischen Technikern und Ethikern. Interdisziplinäre Ausbildung, wie im Artikel erwähnt, ist daher tatsächlich ein Schlüsselelement.

Tobias Werner

24. Dezember 2023 um 15:45Der Artikel bietet einen guten Überblick, lässt aber einen wichtigen Aspekt außer Acht: den wirtschaftlichen Druck. In der Praxis stehen ethische Überlegungen oft in Konkurrenz zu wirtschaftlichen Interessen und Zeitdruck. Als Softwareentwickler in der Robotik muss ich sagen, dass wir oft nicht die Ressourcen haben, um alle ethischen Implikationen gründlich zu durchdenken. Hier sind auch die Unternehmensleitungen und letztlich die Verbraucher gefragt, die bereit sein müssen, für ethisch entwickelte Produkte mehr zu zahlen oder längere Entwicklungszyklen zu akzeptieren.

Hinterlassen Sie einen Kommentar